“No podremos abordar los grandes retos a los que nos enfrentamos como especie sin progreso tecnológico”

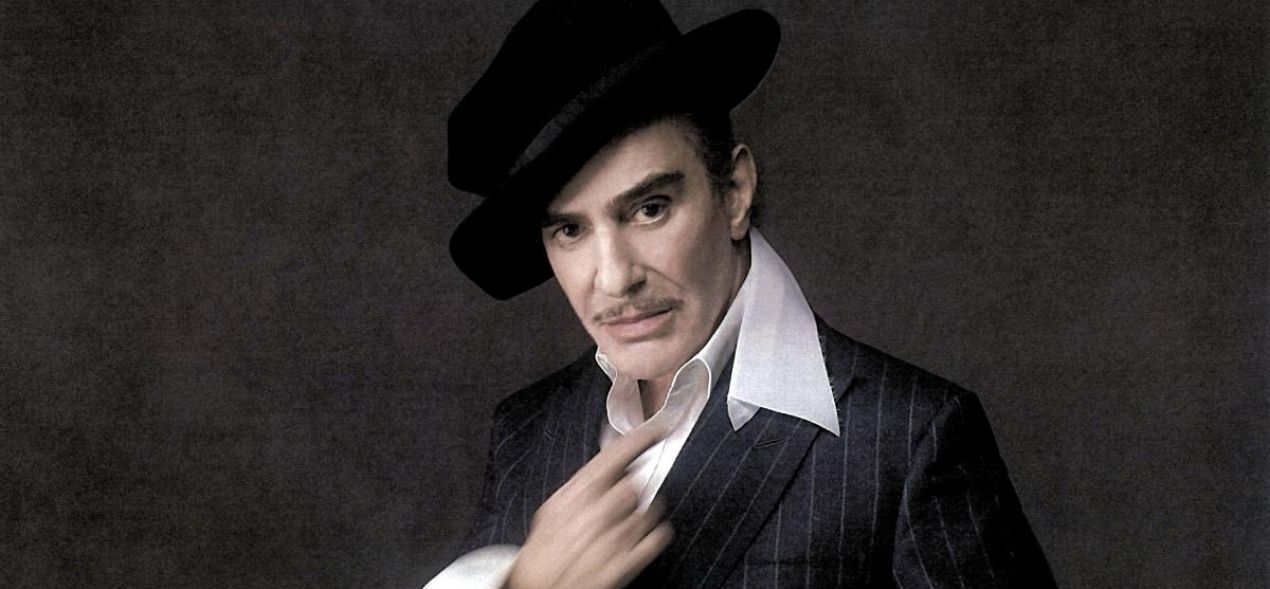

Nuria Oliver, experta en inteligencia artificial y ‘big data’

Cree en el potencial de la tecnología para hacer el bien, aunque también es consciente de que lo tiene para el mal. Nuria Oliver defiende que para que de esta cuarta revolución industrial que vivimos salga una sociedad mejor, la justicia, la educación y la ética serán claves.

Está considerada como una de las mayores autoridades en España en big data e inteligencia artificial. Su trayectoria la avala. Tras licenciarse en Ingeniería de Telecomunicaciones en la Politécnica de Madrid, Nuria Oliver se fue a hacer un postgrado en el MIT, donde se doctoró en inteligencia perceptual. Allí creó uno de los primeros sistemas del mundo de reconocimiento de expresiones faciales. En el año 2000 se unió como investigadora a los laboratorios de investigación en Microsoft (Microsoft Research) en Redmond. Volvió a España en 2007 como directora científica en Telefónica I+D (fue la primera y en ese momento también era la única directora científica mujer). En noviembre de 2016 dejó Telefónica y se unió a DataPop Alliance, una organización internacional sin ánimo de lucro creada por Harvard, el MIT Media Lab y Overseas Development Institute con el objetivo de aprovechar el big data para mejorar el mundo. En enero del 2017 se incorporó también a Vodafone como directora de investigación en ciencias de datos. “Trabajamos en todo tipo de proyectos relacionados con entender mejor a las personas a partir de los datos de los móviles, bien para personalizar su experiencia, bien para identificar nuevos servicios que puedan ser relevantes. Y sobre todo en un área que he creado y es el uso de la inteligencia artificial y las ciencias de datos para el bien social”, explica. “Estamos trabajando en proyectos de salud pública. Por ejemplo, de enfermedades infecciosas como la malaria. A partir del análisis de los datos podemos cuantificar la movilidad humana, y la movilidad humana es crítica para la propagación de las enfermedades infecciosas. También estamos trabajando en la inclusión financiera en África, algo clave para contribuir a la prosperidad de los países”.

Llevas tiempo defendiendo ese uso de las nuevas tecnologías para el bien social, pero ¿crees que en general es así, que las empresas tecnológicas – y tú has pasado ya por unas cuantas— están contribuyendo al progreso social?

Sí, está demostrado, no es que yo lo crea. El progreso tecnológico indudablemente ha contribuido a mejorar la calidad de vida en el mundo. No tienes más que ver la esperanza de vida que tenemos hoy en día en comparación con la de hace cien años, y en gran parte se debe al progreso científico-tecnológico. Es obvio que está teniendo un impacto positivo en la sociedad. Pero también tiene un coste. Existe un coste medioambiental: el consumo de la industria tecnológica puede representar hasta un 20% del consumo total de energía. Eso es algo que tenemos que intentar reducir y, si es posible, eliminar. En lo últimos años también ha aumentado la desigualdad en el mundo, y aunque no sea la única causa, existe la hipótesis de que el desarrollo de grandes imperios tecnológicos pueda estar contribuyendo a ello. Debemos aspirar a que el progreso tecnológico se traduzca en progreso social. Tenemos una gran oportunidad, porque no vamos a conseguir una medicina de precisión—es decir, predictiva, preventiva y personalizada—, ni podremos contribuir a la inclusión financiera, ni abordar los grandes retos a los que nos enfrentamos como especie, como el cambio climático o la escasez de recursos, sin progreso tecnológico. Pero debemos asegurarnos de maximizar sus beneficios y minimizar las potenciales consecuencias negativas.

Hablando de consecuencias negativas, hay gente que cuando oye inteligencia artificial piensa en robots que van a quitarnos el trabajo. ¿Tiene base ese miedo?

Ninguna, es un miedo fundamentalmente sensacionalista. En parte alimentado por los titulares de los medios. En primer lugar hay que entender lo que es la inteligencia artificial. La IA es una disciplina dentro de la ingeniería o de la informática cuyo objetivo es el desarrollo de sistemas computacionales no biológicos inteligentes que toma como referencia la inteligencia humana. En este contexto la inteligencia humana es múltiple: tenemos inteligencia lógica, verbal, creativa, social, emocional, musical, etcétera. Lo que significa que dentro de la IA hay muchas ramas. Al mismo tiempo tenemos diferentes tipos de habilidades. Por ejemplo, podemos percibir, interpretar e interactuar con el mundo real. Hay áreas dentro de la IA que se encargan de intentar emular esas habilidades. Por ejemplo, los sistemas de visión por ordenador, de reconocimiento del habla o de robots que interactúan con el mundo. La gran mayoría de los sistemas de IA que existen hoy en día no se ven. No son robots, es software. Cualquier persona que utilice servicios de internet o aplicaciones en su smartphone está utilizando sistemas de IA. Desde Facebook y Twitter a las recomendaciones de películas en Netflix, de libros en Amazon o de música en Spotify. Según Statista, el mercado de la IA supera ya los 4.000 millones de dólares. O sea que no es algo del futuro, ya está aquí. Obviamente va a transformar la sociedad. Ya lo está haciendo. Nos encontramos en la cuarta revolución industrial y la IA tiene una serie de características que equiparan su papel, en cierto sentido, al que jugó la electricidad en la segunda, porque es transversal. Se puede aplicar en cualquier disciplina: a la medicina, la educación, el comercio, etcétera. Es ubicua, escalable, compleja y al mismo tiempo manejable. Además tiene capacidad de predecir. Y es actualizable. Está en el corazón de esta cuarta revolución industrial que está transformando la sociedad, y tal y como ocurrió con las tres primeras, se está produciendo también una transformación del mercado laboral. Habrá trabajos que se automatizarán parcial o totalmente, y habrá otros nuevos que surgirán. Según las previsiones del Foro Económico Mundial, para el año 2021 se crearán 58 millones de nuevos puestos. La cuestión no es si la IA va a destruir puestos de trabajo, la clave es que los nuevos que van a surgir van a ser muy diferentes. Si como sociedad no nos preparamos ofreciendo oportunidades de aprendizaje y de educación a las personas cuyos trabajos se van a ver transformados, probablemente no estaremos preparados para hacer esta transición.

Gente como Stephen Hawking, Elon Musk o Bill Gates han avisado de que debemos abordar con cuidado la creación de inteligencias artificiales, y no porque vayan a quitarnos el trabajo precisamente…. ¿Son alarmistas o realmente la IA puede convertirse en una amenaza para nosotros?

Por su potencial y esas características que he comentado (el ser transversal, escalable, ubicua, compleja) no podemos considerar solo la dimensión tecnológica al desarrollar IA. De hecho tenemos que tener en cuenta otras cuatro más: la legal y regulatoria (necesitamos un marco legal adecuado para una sociedad en la que coexistamos con sistemas inteligentes), la dimensión social (necesitamos educación y formación), la económica y del mercado laboral, de la que hablaba antes, y la ética. Respecto a esta última, hay que trabajar cinco pilares que en inglés se resumen en el acrónimo FATEN. La F es de fairness o justicia. Si los sistemas que desarrollamos están tomando decisiones, tenemos que asegurarnos de que sean justas y no discriminatorias. Como bien sabemos, los humanos no somos perfectos. Nuestras decisiones están sujetas a conflictos de interés, egoísmo, cansancio, manipulación, corrupción, etcétera. La aspiración es que los algoritmos superen las limitaciones de las decisiones humanas, pero con lo que nos estamos encontrando es con que, si no tomamos ciertas precauciones, los sistemas pueden no solamente replicar patrones de discriminación existentes, sino incluso amplificarlos. El sentido de la A es triple: autonomía, atribución de responsabilidad y aumento de inteligencia. La autonomía es uno de los pilares básicos en la ética occidental. Los seres humanos deberíamos ser dueños de nuestras propias acciones y pensamientos. Sin embargo, este principio de autonomía se está viendo violado hoy en día. Muchos de nuestros pensamientos o decisiones no son 100% autónomas, como hemos visto últimamente en las elecciones norteamericanas o en el Brexit. La opinión ciudadana se puede manipular. Con respecto a la atribución de responsabilidad, deberíamos tener muy claras las posibles consecuencias del uso de la tecnología. Y en cuanto al aumento de inteligencia, no se trata en realidad de sustituir al ser humano, sino de aumentar su visión. Los humanos somos muy buenos en ciertas cosas y los ordenadores lo son en otras. La idea es que nos complementemos. La T es de transparencia. La clave es que haya transparencia, pero no solo en relación al tema de los datos, también, por ejemplo, respecto a por qué un algoritmo decide lo que decide. La E es doble, de educación y beneficencia. Deberíamos intentar maximizar el impacto positivo que la tecnología, y en particular la IA, tienen sobre la sociedad, para que realmente contribuyan a su progreso. La N es de no maleficencia, que es algo diferente. No se trata solo de maximizar lo positivo, sino también de minimizar lo negativo. Debemos asegurarnos de que los sistemas que desarrollemos tengan unas garantías de seguridad, de fiabilidad y de reproducibilidad. Y que, además, apliquemos un principio de prudencia, preservando siempre la privacidad de las personas.

¿Ves un futuro en el que los robots tengan conciencia y sean capaces de asumir ideas como justicia, libertad, amor u odio?

Otra manera de analizar los sistemas de IA es por cómo de competentes son cuando los comparamos con los humanos. Lo que tenemos hoy en día, y así será durante mucho tiempo, son sistemas de inteligencia artificial específica. Son muy buenos en una cosa pero solo en esa cosa. Por ejemplo, desde hace ya muchos años el mejor jugador del mundo de ajedrez es un algoritmo. Ese algoritmo ni siquiera sabe lo que es el ajedrez, y solo sabe hacer eso, nada más. Si cambiásemos las reglas del ajedrez tendría problemas para poder jugar, no se podría adaptar. El siguiente paso, la aspiración original de la IA, sería que fuera una inteligencia general, similar a la humana. Estamos aún muy lejos de llegar a eso, pero, además, tampoco es necesario para que la inteligencia artificial sea útil y tenga impacto. La Ley de Moore [formulada en 1965 por el cofundador de Intel Gordon E. Moore] estableció que cada año o cada año y medio se duplicaría la capacidad de computación por el mismo precio. Por eso cuando te compras un móvil o un portátil se queda obsoleto al año siguiente. Aplicando este principio, la capacidad de computación debería seguir y seguir creciendo exponencialmente. Hay autores como Nick Bostrom, de la Universidad de Oxford, que dicen que no hay motivo para detenerse en la inteligencia humana. Y teóricamente, si conseguimos seguir aumentando la capacidad de computación, podríamos superar la inteligencia humana. Es lo que se llama superinteligencia y es un concepto bastante controvertido. No lo podemos entender, de la misma manera que una hormiga no puede entender nuestra inteligencia.

Cambiando de tema, ¿alguna idea para acabar con la brecha de género en las profesiones STEM?

Tengo muchas, he dado muchas charlas sobre este tema. La situación es más que patética. Estamos mucho peor que en los años ochenta por diferentes motivos. Uno de los principales es que la informática y las ingenierías cercanas a la informática tienen un problema de imagen. Existe un idea clara sobre quién se dedica a estas carreras. Si te digo que cierres los ojos y te imagines a una persona cuyo trabajo es programar ordenadores, probablemente te imagines a un chico con gafas, gordito, en un sótano, haciendo cosas que nadie entiende delante de unas pantallas. Es una imagen muy poco atractiva en general, pero en particular para las chicas. Tenemos que eliminar este estereotipo porque no se corresponde con la realidad. Además, parece un trabajo solitario, cuando en realidad es multidisciplinar y tiene un carácter muy social, porque la mayoría de los proyectos son colaborativos. Llevo años proponiendo que se introduzca una asignatura troncal desde Primaria que se llame Pensamiento Computacional y que aborde cinco materias: algoritmos, programación, redes, datos y hardware. Cualquier niño, niña o adolescente del siglo XXI debería dominar estas cinco materias. No consiste en poner un ordenador en el aula o coger un libro electrónico, sino en enseñar esas cinco áreas de conocimiento. Muchas veces no necesitas ni un ordenador para entenderlas o enseñarlas, al menos inicialmente. Además, creo que tampoco estamos reforzando lo suficiente habilidades de las inteligencias creativa, social y emocional, que son las que nos caracterizan como seres humanos y que cada vez van a ser más importantes. Y esto tiene esto que ver con la brecha de género, porque si las fomentamos estaremos fomentando una mayor apertura de mente, una mayor tolerancia a la diversidad y a otros puntos de vista. Hay otros dos problemas que explican que haya pocas mujeres que no son exclusivos del sector tecnológico, pero impactan en él. Uno son los sesgos de género, que tenemos todos, tanto hombres como mujeres. La solución son las evaluaciones ciegas al género. Es muy difícil, pero funciona en algunos campos. El caso emblemático son las orquestas sinfónicas. Hasta los años setenta no había casi mujeres en ellas, el 95% eran hombres, y lo explicaban por un factor genético, porque las mujeres no podían ser virtuosas. Como nadie había demostrado ni que sí ni que no, se quedaron con esta idea. Hasta que una orquesta decidió hacer audiciones ciegas. Pusieron una pantalla entre los candidatos y el jurado, de forma que no vieran quién estaba tocando. Aumentó significativamente el número de mujeres que superaban la prueba. Podría hacerse no dando ningún tipo de información referente al género en los currículum, ni nombres de pila ni fotos, para evitar el sesgo. Otra fórmula es que para adjudicar posiciones de liderazgo, premios o reconocimientos se exija diversidad en el pool de candidatos. Ya lo están haciendo algunos laboratorios. O premiar la diversidad, que los equipos que tengan distintos perfiles tengan algún tipo de incentivo o beneficio. También influyen la falta de visibilidad, la falta de reconocimiento y la brecha salarial. Si miramos los premios Nobel en disciplinas STEM, el 97% han sido para hombres. La medalla Fields solo la ha conseguido un mujer, que desgraciadamente falleció de cáncer hace poco. Lo mismo ocurre con el premio Turing, el equivalente al Nobel en informática. Desde que existe, en el año 66, solo se lo han dado a dos mujeres y media, y digo esto porque un año se lo dieron a una mujer y un hombre al mismo tiempo. Pero no hay que irse tan lejos, los Premios Nacionales de Investigación fueron cancelados durante la crisis porque no había dinero y cuando se recuperaron se dieron cinco y ninguno a mujeres. Para que no ocurra hay que dar más visibilidad a las mujeres. Por último, el cuarto factor es exclusivo de la industria tecnológica. Su cultura, sobre todo en Estados Unidos, es extremadamente misógina y sexista. Es la cultura brogrammer, y afecta desde a startups a empresas enormes como Google. Allí ha habido muchas denuncias por sexismo y acoso. Hay que tener tolerancia cero ante este tipo de comportamientos. También ayuda establecer redes de mentorización para que las profesionales que trabajan en el sector tecnológico se den cuenta de que no están solas y puedan ayudarse mutuamente. Reforzar los vínculos para cualquier colectivo en desventaja, y en este caso son las mujeres, siempre es importante.

Tú ya eres un referente en tu sector. ¿Qué les dirías a las niñas para animarlas a estudiar estas carreras?

Lo más importante es que cada uno haga lo que le apasiona. Mi primera recomendación es que sepan en qué consisten estas carreras y que no se dejen engañar por los estereotipos de las series o las películas, porque no tienen nada que ver con la realidad. Son las carreras con más perspectivas de futuro, donde hay más trabajo, y están entre las mejor pagadas. Y además es fácil conciliar, porque permiten mucha flexibilidad y es normal trabajar desde casa. Eso es algo que no se destaca lo suficiente.

Formas parte del Grupo de Sabios del Gobierno para IA y ‘big data’. ¿Quiénes estáis en él?

Es un grupo extremadamente multicisciplinar y me alegra, porque, de hecho, fue una de las sugerencias que hice a la Secretaría de Estado. Somos cinco mujeres y cuatro hombres, además de diferentes generaciones, de empresas tanto públicas como privadas, de oenegés, y universidades. También de diferentes áreas de expertise: hay un experto en economía, dos en derecho, dos expertas en la aplicación de la IA en empresas, una persona de Naciones Unidas, una experta en ética que trabaja en una onegé, una catedrática de Ingeniería de IA de la Universidad Politécnica de Madrid y yo.

¿Y cómo va ese Libro Blanco sobre la IA que preparáis y que se iba a publicar a mediados de año?

En los próximos días el Gobierno va a publicar su estrategia de i+D+i en IA, pero del Libro Blanco no creo que salga nada. Con las elecciones se retrasó la publicación, que estaba prevista para julio y finalmente no sé si se va a hacer, lo que es una pena. La UE exige a todos los estados miembros que expliquen su estrategia nacional de IA, por lo que España tendrá que publicar algo para mediados de año y espero que se aproveche parte de ese trabajo que hemos hecho para el Libro Blanco.

Esta entrevista se publicó primero en la última edición de nuestra revista en papel.