La IA tiene un ‘tipo’ muy concreto de mujer

Un estudio de la Universidad Europea confirma que la inteligencia artificial sigue viendo a la mujer de forma muy limitada

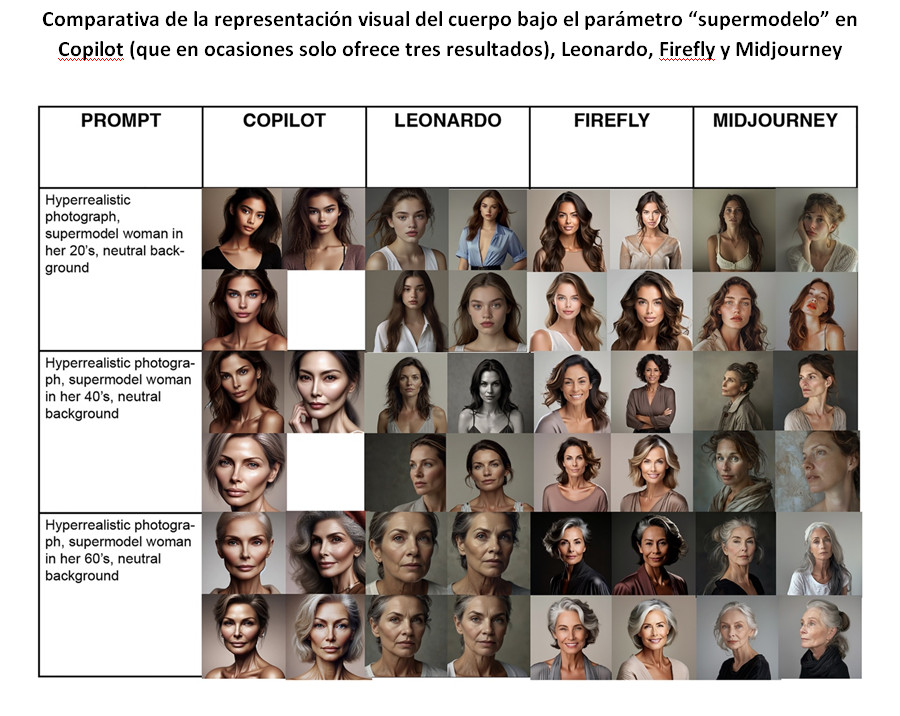

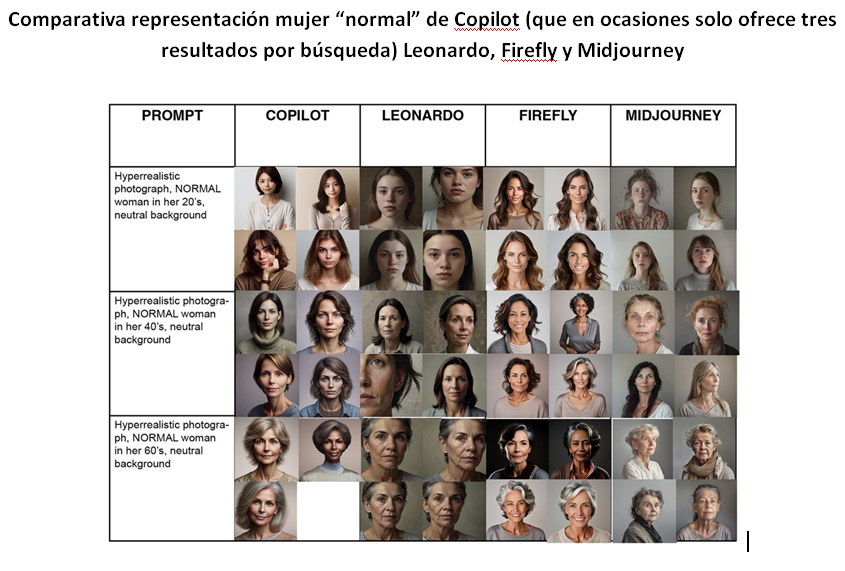

Jóvenes, caucásicas y con cuerpos normativos: así son las mujeres según la inteligencia artificial. Un estudio de la Universidad Europea que ha analizado más de 350 retratos creados con herramientas como Copilot, Leonardo y Midjourney, confirman que existe una sobrerrepresentación de imágenes con este patrón. “Estas limitaciones ponen en evidencia cómo la IA perpetúa los sesgos presentes en los datos de entrenamiento, afectando la pluralidad de las representaciones visuales”, afirma Esmeralda López, profesora de comunicación de la Universidad Europea.

El estudio incide también en el hecho de que los calificativos inclusivos no corrigen sesgos, ya que incluso utilizando términos como ‘belleza real’, las inteligencias artificiales siguen generando imágenes que responden a cánones tradicionales. Sí que se detectan filtros éticos en algunas herramientas (Copilot y Firefly) que bloquean prompts como ‘muy fea’ por políticas de moderación.

“Este estudio deja claro que se necesitan medidas inmediatas en el desarrollo de estas herramientas. Dejar de reproducir los sesgos estructurales presentes en los datos es clave para avanzar hacia una publicidad ética y alineada con una realidad plural”, afirma Begoña Moreno, profesora de Publicidad en la Universidad Europea y otra de las autoras del informe.

Otro hallazgo relevante es que el idioma influye en los niveles de diversidad. Las imágenes generadas a partir de descripciones textuales en inglés presentaban una mayor variedad en comparación con aquellas creadas con instrucciones en español. Según los autores del estudio, esto responde a la predominancia de corpus entrenados mayoritariamente en inglés, lo que limita los resultados en otros idiomas.

A pesar de los importantes avances tecnológicos, los investigadores subrayan que muchas imágenes generadas carecen de emotividad y espontaneidad. La mayoría de los retratos presentan expresiones serias o neutras, lo que reduce su capacidad para transmitir mensajes auténticos y con impacto emocional. Para mitigar esta problemática, los investigadores proponen “integrar equipos multidisciplinares en el diseño de modelos de IA, fomentar la supervisión ética en los procesos creativos y ampliar la diversidad de los datos utilizados en el entrenamiento de las herramientas”.

El análisis pone de manifiesto la importancia de seguir desarrollando herramientas tecnológicas que reflejen la riqueza de la sociedad. “Si queremos que la IA sea una herramienta transformadora, debemos asegurarnos de que su desarrollo esté guiado por principios éticos y compromisos firmes con la diversidad y la inclusión”, indican los expertos en la Universidad Europea.